GLM-5-Turbo: цены, сравнение с GLM-5 и настройка OpenClaw

Zhipu AI выпустила GLM-5-Turbo: $1.20/1M input, tool call error rate 0.67%, закрытая лицензия. Сравнение с GLM-5, ценами конкурентов и инструкция подключения.

TL;DR: Zhipu AI выпустила GLM-5-Turbo — закрытую версию GLM-5 для агентных задач. $1.20/1M токенов на вход, контекст 200K, ошибки вызова инструментов 0.67% (у базовой GLM-5 — от 2.3% до 6.4%). Доступна через API и на OpenRouter.

Китайская Zhipu AI (торговая марка Z.AI) выпустила GLM-5-Turbo, вариант флагманской GLM-5, оптимизированный для агентных воркфлоу. Главная целевая платформа — OpenClaw, независимый open source проект.

Чем GLM-5-Turbo отличается от GLM-5

GLM-5-Turbo построена на базе GLM-5 (744B параметров, MoE с ~44B активных на токен), но заточена под агентное выполнение. Основные отличия по данным OpenRouter:

| GLM-5 | GLM-5-Turbo | |

|---|---|---|

| Контекст | 200K | 200K |

| Макс. выход | 128K | 128K |

| Лицензия | MIT (open source) | Закрытая |

| Tool call error rate | 2.3–6.4% | 0.67% |

| E2E latency | 9.3–11.2 сек | 8.2 сек |

| Throughput | 40–70 tok/s (зависит от провайдера) | ~48 tok/s |

| First token latency | 0.4–1.1 сек | 2.9 сек |

Главная разница в надёжности вызова инструментов: 0.67% ошибок против 2.3–6.4% у базовой модели. Для агентов, которые цепочкой вызывают инструменты, каждый промах может сорвать весь воркфлоу. Тут Turbo заметно стабильнее.

Зато первый токен приходит медленнее (2.9 сек против 0.4–1.1 сек у GLM-5 через Friendli/Parasail). Для чат-ботов это минус, для агентов, где важнее завершить задачу целиком, менее критично.

Сколько стоит

Цены на Z.AI API: $1.20/1M input, $4.00/1M output. На OpenRouter со скидкой 20%: $0.96/$3.20. Для контекста, по данным TokenCost:

| Модель | Input/1M | Output/1M |

|---|---|---|

| MiniMax M2.5 | $0.15 | $0.60 |

| Kimi K2.5 | $0.35 | $1.40 |

| GLM-5 (base) | $1.00 | $3.20 |

| GLM-5-Turbo | $1.20 | $4.00 |

| Claude Haiku 4.5 | $1.00 | $5.00 |

| Claude Sonnet 4.5 | $3.00 | $15.00 |

| Claude Opus 4.6 | $5.00 | $25.00 |

GLM-5-Turbo стоит чуть дороже базовой GLM-5, и в 8 раз дороже MiniMax M2.5. При этом MiniMax M2.5 набирает 80.2 на SWE-bench против 77.8 у GLM-5. Аргумент Zhipu в том, что SWE-bench не измеряет то, что важно для агентов: стабильность длинных цепочек вызовов и работу с инструментами.

Для подписчиков GLM Coding доступны тарифы: Lite ($27/квартал), Pro ($81/квартал), Max ($216/квартал). Pro-подписчики получают GLM-5-Turbo сразу, Lite — с апреля.

Как подключить GLM-5-Turbo

Через OpenAI SDK

API совместим с OpenAI SDK. Минимальная миграция:

from openai import OpenAI

client = OpenAI(

api_key="ваш-z-ai-api-key",

base_url="https://api.z.ai/api/paas/v4/",

)

response = client.chat.completions.create(

model="glm-5-turbo",

messages=[

{"role": "user", "content": "Ваш промпт"}

],

)

Через OpenRouter дешевле ($0.96 вместо $1.20 за 1M input) и есть автоматические фоллбэки:

from openai import OpenAI

client = OpenAI(

api_key="ваш-openrouter-key",

base_url="https://openrouter.ai/api/v1",

)

response = client.chat.completions.create(

model="z-ai/glm-5-turbo",

messages=[

{"role": "user", "content": "Ваш промпт"}

],

)

Поддерживаются function calling, thinking mode, structured output и стриминг. Ключ API получается на z.ai.

В OpenClaw

Инструкция по документации Z.AI:

- Установить OpenClaw:

curl -fsSL https://openclaw.ai/install.sh | bash

- При настройке (

openclaw onboard --install-daemon) выбрать Z.AI как провайдера и ввести API-ключ. - Переключить модель на GLM-5-Turbo. В файле

~/.openclaw/openclaw.jsonдобавить модель в секциюmodels.providers.zai.models:

{

"id": "glm-5-turbo",

"name": "GLM-5-Turbo",

"reasoning": true,

"input": ["text"],

"contextWindow": 204800,

"maxTokens": 131072

}

- Поменять дефолтную модель в

agents.defaults.model:

"primary": "zai/glm-5-turbo",

"fallbacks": ["zai/glm-5", "zai/glm-4.7"]

- Перезапустить:

openclaw gateway restart.

Skills (навыки агента) ставятся через ClawHub: clawhub search "тема" → clawhub install название. Именно рост использования Skills с 26% до 45% стал одной из причин, почему Zhipu сделала отдельную модель под OpenClaw.

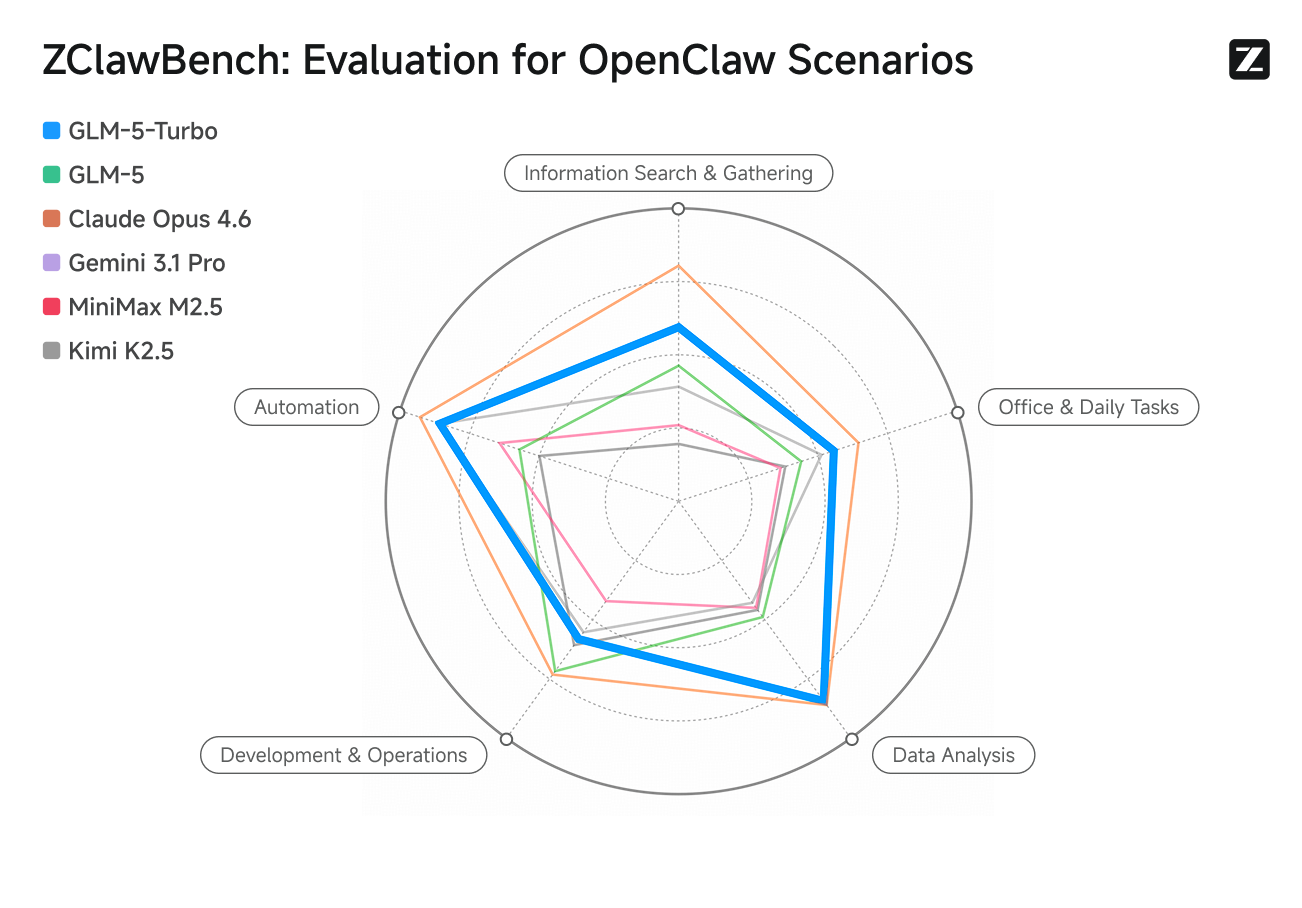

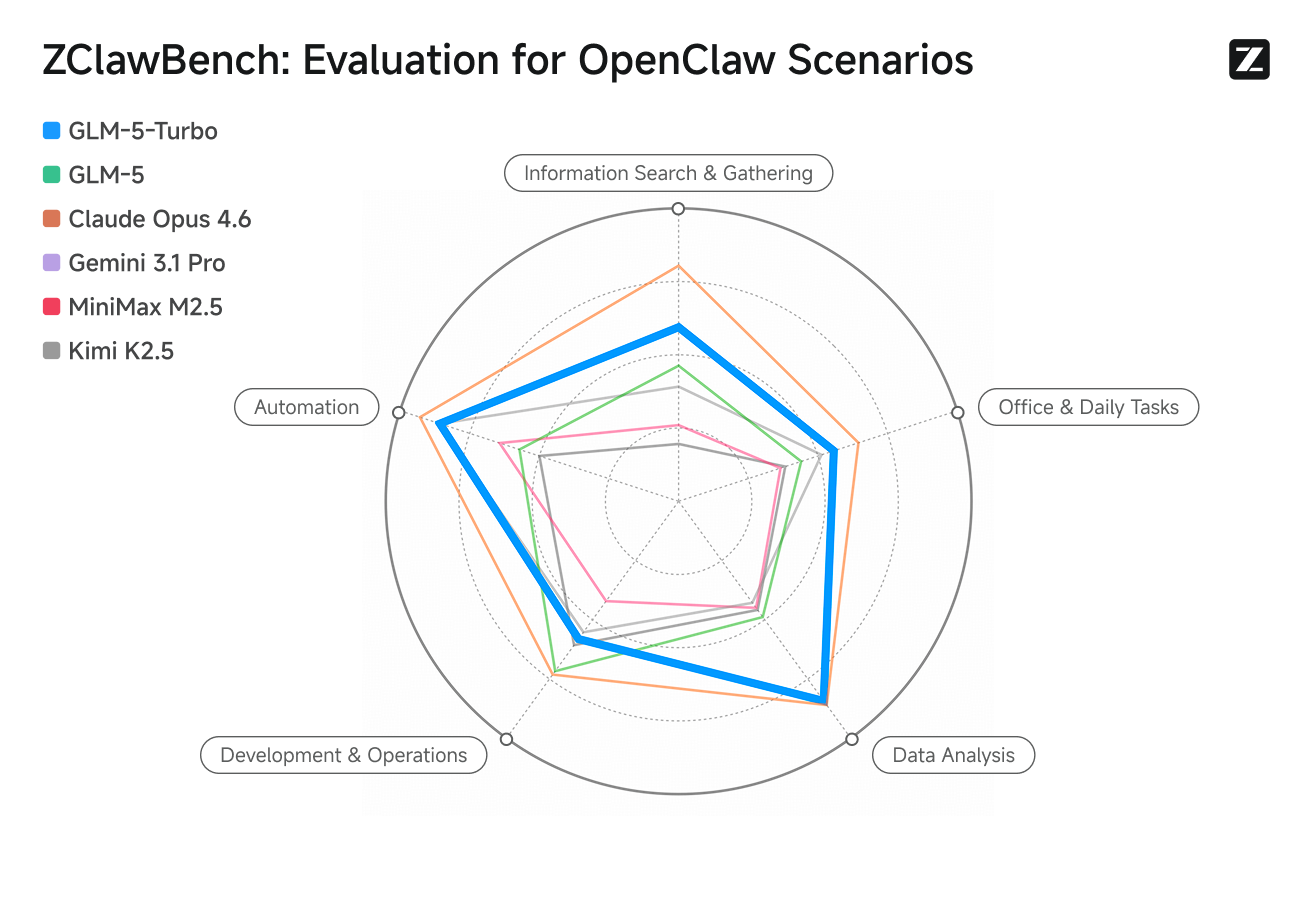

Бенчмарк ZClawBench

Вместе с моделью Zhipu представила ZClawBench — свой бенчмарк для агентных сценариев, построенный на типичных задачах OpenClaw. Покрывает настройку окружений, разработку, поиск информации, анализ данных и автоматизацию.

По радарной диаграмме от Zhipu, GLM-5-Turbo обходит базовую GLM-5 во всех категориях. Но тут важная оговорка: конкретные цифры ZClawBench пока не опубликованы, это данные вендора без независимой валидации. Датасет и траектории выложены в открытый доступ, так что проверить можно.

Zhipu пошли нетипичным путём: вместо того чтобы взять готовую модель и прикрутить function calling сверху, они тренировали GLM-5-Turbo на агентных данных с самого начала. По анализу VentureBeat, модель позиционируется не как замена GLM-5, а как коммерческий ответвление: быстрее, стабильнее в агентных цепочках, но закрытая.

GLM-5 вышла под MIT-лицензией, и Zhipu строила репутацию на открытости. GLM-5-Turbo закрыта. Zhipu обещает, что наработки из Turbo попадут в будущие open source релизы, но саму модель открывать не планирует.

Для тех, кто строит агентов и ищет альтернативу OpenAI с Anthropic, GLM-5-Turbo — вариант с нативной поддержкой MCP и OpenAI-совместимым API. Но цена не бюджетная: MiniMax M2.5 в 8 раз дешевле и на SWE-bench набирает больше. Аргумент за Turbo — стабильность инструментов в длинных агентных цепочках, и тут данные OpenRouter (0.67% ошибок) пока выглядят убедительно.

Что ещё почитать

- GLM-4.7: что нового в модели Zhipu — предыдущее поколение моделей Zhipu

- Память AI-агентов: контекст, RAG, графы и mem0 — как агенты работают с контекстом

- Топ-6 AI-агентов для кода в 2026 — обзор конкурентов в агентном пространстве