Z.ai + Claude Code: GLM-модели за $10/мес

Пошаговая настройка Z.ai для Claude Code с shell-алиасом glm — GLM-модели в 5-7 раз дешевле Anthropic.

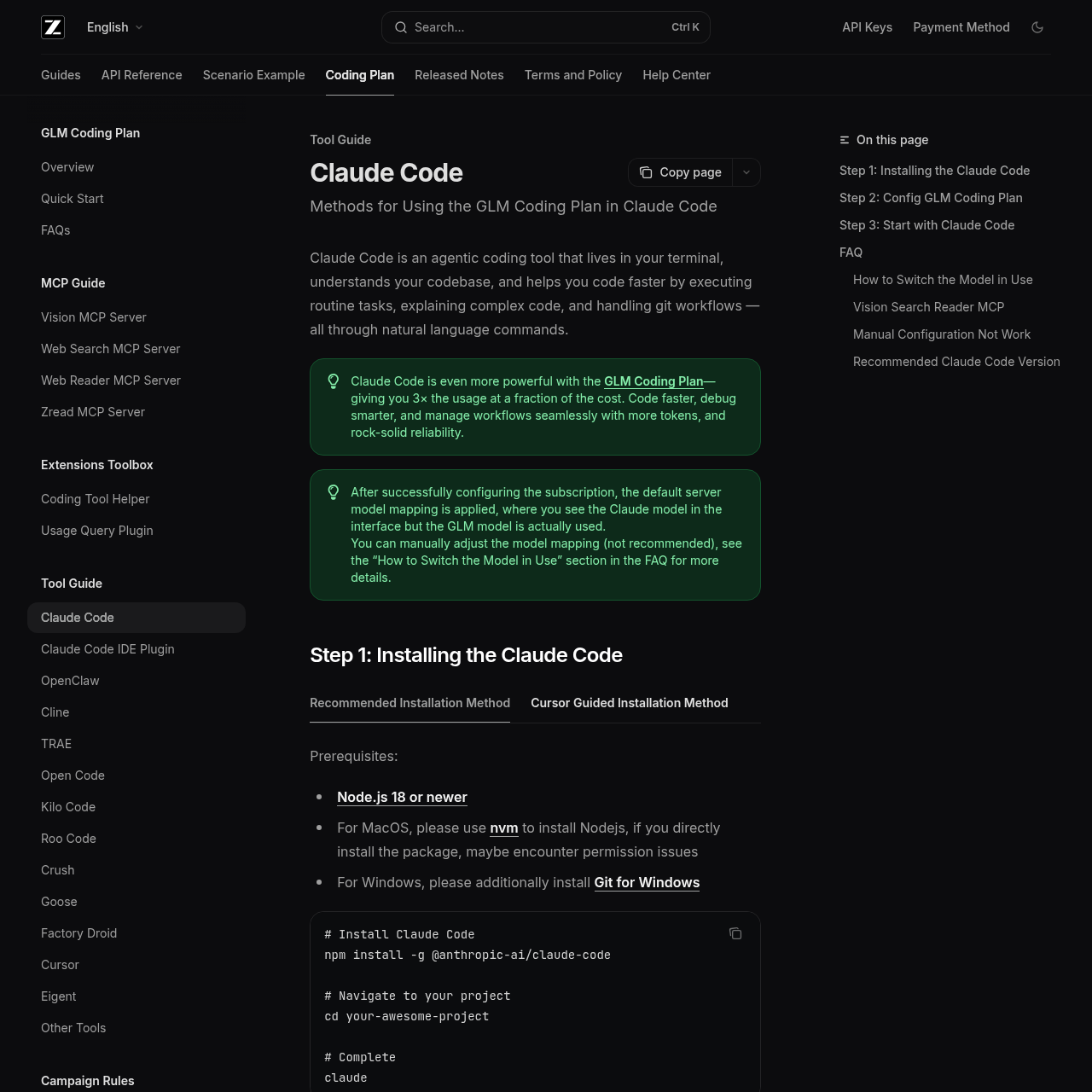

TL;DR: Подключаем Z.ai к Claude Code за 5 минут. Получаем доступ к GLM-моделям за $10/мес вместо $100 за подписку Anthropic Max. В конце настроим shell-алиас glm, чтобы переключаться одной командой.Z.ai (Zhipu AI) делают свои модели семейства GLM — от бесплатных до флагманского GLM-5 с 744 миллиардами параметров. Для разработчиков у них есть GLM Coding Plan, заточенный под работу с Claude Code и другими AI-кодинговыми инструментами. Цены при этом в 5-7 раз ниже, чем у Anthropic напрямую.

Что понадобится

- Claude Code (установленный и работающий)

- Аккаунт на z.ai (регистрация бесплатная)

- Карта для оплаты тарифа (от $10/мес) или API-кредиты

- Терминал с zsh или bash

Шаг 1. Регистрация на Z.ai

Заходи на z.ai и создай аккаунт. Можно войти через Google или GitHub — быстрее всего.

После регистрации попадёшь на главную страницу. Нам нужно два места: страница с API-ключами и выбор тарифа.

Шаг 2. Выбираем тариф

Переходи на z.ai/subscribe. Есть два варианта оплаты.

GLM Coding Plan — подписка с фиксированной ценой:

| План | Цена/мес | Модели | Примерно промптов за 5 часов |

|---|---|---|---|

| Lite | $10 | GLM-4.5, 4.6, 4.7 | ~80 |

| Pro | $30 | + GLM-5 | ~400 |

| Max | $80 | + приоритет | ~1 600 |

Годовая подписка даёт скидку 30%, квартальная — 10%.

Pay-per-token API — платишь за использование:

| Модель | Вход (за 1M токенов) | Выход | С кэшем |

|---|---|---|---|

| GLM-5 | $1.00 | $3.20 | $0.20 |

| GLM-4.7 | $0.60 | $2.20 | $0.11 |

| GLM-4.5-Air | $0.20 | $1.10 | $0.03 |

| GLM-4.7-Flash | Бесплатно | Бесплатно | Бесплатно |

Для сравнения: Claude Sonnet 4.5 стоит $3/$15. GLM-4.7 при $0.60/$2.20 выходит в 5-7 раз дешевле.

Мой совет: начни с Lite за $10. Если квоты не хватает — перейдёшь на Pro. GLM-4.7 покрывает большинство задач.

Шаг 3. Получаем API-ключ

Зайди на страницу API Keys в личном кабинете Z.ai. Нажми «Create API Key», дай ему название (например, «claude-code»). Скопируй ключ — он начинается с нескольких символов и показывается только один раз.

Сохрани ключ в переменную окружения. Открой ~/.zshrc (или ~/.bashrc) и добавь:

export ZAI_API_KEY="вставь-свой-ключ-сюда"

Перезагрузи терминал или выполни source ~/.zshrc.

Шаг 4. Настраиваем Claude Code

Есть два способа. Я рекомендую второй — он удобнее для переключения.

Способ A: Глобально через settings.json

Если хочешь, чтобы Claude Code всегда работал через Z.ai, отредактируй ~/.claude/settings.json:

{

"env": {

"ANTHROPIC_BASE_URL": "https://api.z.ai/api/anthropic",

"ANTHROPIC_AUTH_TOKEN": "вставь-свой-ключ",

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": "1"

}

}

CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC отключает телеметрию — Z.ai не поддерживает некоторые Anthropic-эндпоинты, и без этого флага будут ошибки в логах.

Способ B: Shell-алиас (рекомендую)

Этот способ позволяет использовать и оригинальный Claude Code (через подписку Anthropic), и Z.ai — переключаясь одной командой. Добавь в ~/.zshrc:

glm() {

ANTHROPIC_BASE_URL=https://api.z.ai/api/anthropic \

ANTHROPIC_AUTH_TOKEN="$ZAI_API_KEY" \

CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1 \

claude "$@"

}

Теперь claude работает как обычно (через Anthropic), а glm запускает Claude Code через Z.ai. Все аргументы пробрасываются: glm --model glm-4.7, glm -p "объясни этот код" — всё работает.

Перезагрузи терминал:

source ~/.zshrc

Шаг 5. Настраиваем маппинг моделей

По умолчанию Z.ai сам маппит алиасы Claude Code на GLM-модели. Но можно переопределить вручную. Добавь в ~/.zshrc (или прямо в функцию glm):

glm() {

ANTHROPIC_BASE_URL=https://api.z.ai/api/anthropic \

ANTHROPIC_AUTH_TOKEN="$ZAI_API_KEY" \

CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1 \

ANTHROPIC_DEFAULT_OPUS_MODEL=glm-5 \

ANTHROPIC_DEFAULT_SONNET_MODEL=glm-4.7 \

ANTHROPIC_DEFAULT_HAIKU_MODEL=glm-4.5-air \

claude "$@"

}

Теперь при переключении на /model opus в сессии Claude Code ты получишь GLM-5, на sonnet — GLM-4.7, на haiku — GLM-4.5-Air.

Если у тебя тариф Lite (без GLM-5), поставь glm-4.7 для opus:

ANTHROPIC_DEFAULT_OPUS_MODEL=glm-4.7 \

Шаг 6. Проверяем

Запусти:

glm

Должна открыться стандартная сессия Claude Code. Попробуй что-нибудь простое: попроси объяснить файл или написать функцию. Если ответ пришёл — всё работает.

Проверить, какая модель используется, можно командой /model внутри сессии.

Если хочешь запустить с конкретной моделью:

glm --model glm-4.7

Шаг 7. Бонус — алиасы для других провайдеров

Тот же подход работает для любого Anthropic-совместимого провайдера. Вот набор, который можно добавить в ~/.zshrc:

# Z.ai (GLM-модели)

glm() {

ANTHROPIC_BASE_URL=https://api.z.ai/api/anthropic \

ANTHROPIC_AUTH_TOKEN="$ZAI_API_KEY" \

CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1 \

claude "$@"

}

# DeepSeek

dsk() {

ANTHROPIC_BASE_URL=https://api.deepseek.com/anthropic \

ANTHROPIC_AUTH_TOKEN="$DEEPSEEK_API_KEY" \

CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1 \

claude "$@"

}

Теперь: claude — Anthropic, glm — Z.ai, dsk — DeepSeek.

Результат

Если всё сделал правильно, команда glm запускает Claude Code через Z.ai с GLM-моделями, а claude продолжает работать через Anthropic. Переключаешься одной командой в терминале, без перенастройки конфигов.

Частые ошибки

«Connection error» или таймаут при запуске

Проверь, что ANTHROPIC_BASE_URL указан правильно: https://api.z.ai/api/anthropic (именно /api/anthropic, не /api/paas/v4). Второй эндпоинт — для OpenAI-совместимого API, Claude Code его не поймёт.

«Invalid API key» или 401 ошибка

Убедись, что ключ передаётся через ANTHROPIC_AUTH_TOKEN, а не через ANTHROPIC_API_KEY. Z.ai использует Bearer-авторизацию. Проверь также, что ключ не содержит лишних пробелов — echo "$ZAI_API_KEY" должен выводить ключ без пробелов.

Ошибки связанные с beta-features

Некоторые Anthropic-специфические функции Z.ai не поддерживает. Добавь в алиас:

CLAUDE_CODE_DISABLE_EXPERIMENTAL_BETAS=1 \

GLM-5 тратит квоту слишком быстро

GLM-5 расходует квоту в 2-3 раза быстрее остальных моделей. В пиковые часы (14:00-18:00 UTC+8) коэффициент ещё выше — 3x. Если квота кончается, переключись на GLM-4.7 — он покрывает большинство задач.

FAQ

Сколько стоит Z.ai по сравнению с подпиской Claude Max?

Claude Max — $100/мес. Z.ai Lite — $10/мес, Pro — $30. По API: GLM-4.7 стоит $0.60/$2.20 за миллион токенов против $3/$15 у Claude Sonnet 4.5. Разница в 5-7 раз. Но имей в виду, что GLM — это другая модель с другим уровнем качества. Для типовых кодинговых задач разницу заметить сложно, но на чём-то вроде сложного рефакторинга или проектирования архитектуры Claude пока сильнее.

Можно ли использовать бесплатные модели Z.ai?

Да. GLM-4.7-Flash и GLM-4.5-Flash бесплатны по API (pay-per-token). Но в GLM Coding Plan они не входят — нужно использовать API-ключ с балансом, а не подписочный. Для Claude Code бесплатные модели работают, но медленнее и с ограничениями по rate limit.

Будут ли работать MCP-серверы и хуки через Z.ai?

Да. MCP-серверы, хуки и CLAUDE.md работают независимо от провайдера модели. Меняется только модель, которая обрабатывает запросы, а вся инфраструктура Claude Code остаётся на месте.

Данные безопасны? Куда уходит код?

Код отправляется на серверы Z.ai в Сингапуре. Согласно их политике, данные API-запросов не используются для обучения моделей и не хранятся после обработки. Но если проект чувствительный, я бы рекомендовал локальные модели через Ollama.

Как проверить, через какого провайдера идёт запрос?

Внутри сессии Claude Code набери /status — там будет видно текущий эндпоинт и модель. Также можно посмотреть в дашборде Z.ai — там логируются все запросы.

Что ещё почитать

- Claude Code с любой моделью: 10 провайдеров 2026 — обзор всех способов подключить сторонние модели

- Переменные окружения Claude Code — полный справочник — все переменные для настройки провайдеров

- Настройка Claude Code — полный гайд по settings.json — подробнее про конфигурацию