GPT-5.4 Mini и Nano: быстрые модели для кода и субагентов

OpenAI выпустила GPT-5.4 Mini и Nano. Mini почти догоняет флагман на кодинге и computer use, но работает вдвое быстрее. Разбираю бенчмарки, цены и когда какую использовать.

TL;DR: OpenAI выпустила GPT-5.4 Mini и Nano. Mini почти догоняет полноразмерную GPT-5.4 на кодинге и computer use, но работает вдвое быстрее и стоит втрое дешевле. Nano ещё дешевле и заточена под классификацию, извлечение данных и простые подзадачи в субагентных системах.

Зачем OpenAI маленькие модели

Не каждая задача требует флагман. Когда AI-агент ищет файл в кодовой базе, парсит скриншот или классифицирует тикет, ему не нужна модель за $15 на миллион токенов. Нужна та, что ответит быстро, вызовет инструменты без ошибок и не съест бюджет за утро.

GPT-5.4 Mini и Nano решают именно эту проблему. Mini заменяет GPT-5 Mini и прибавляет 9–20 п.п. на основных бенчмарках, а Nano создана для задач, где критичны скорость и стоимость.

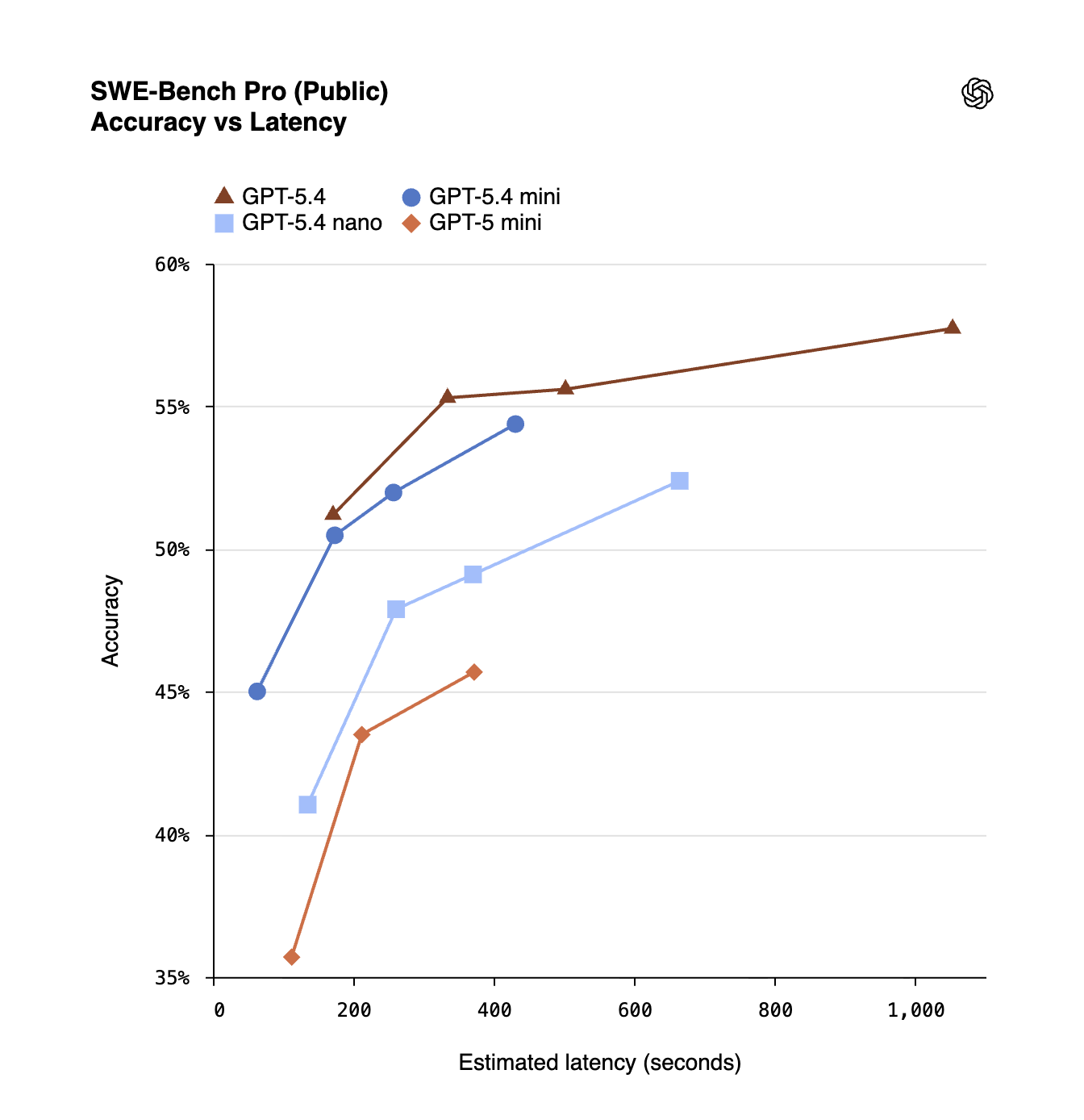

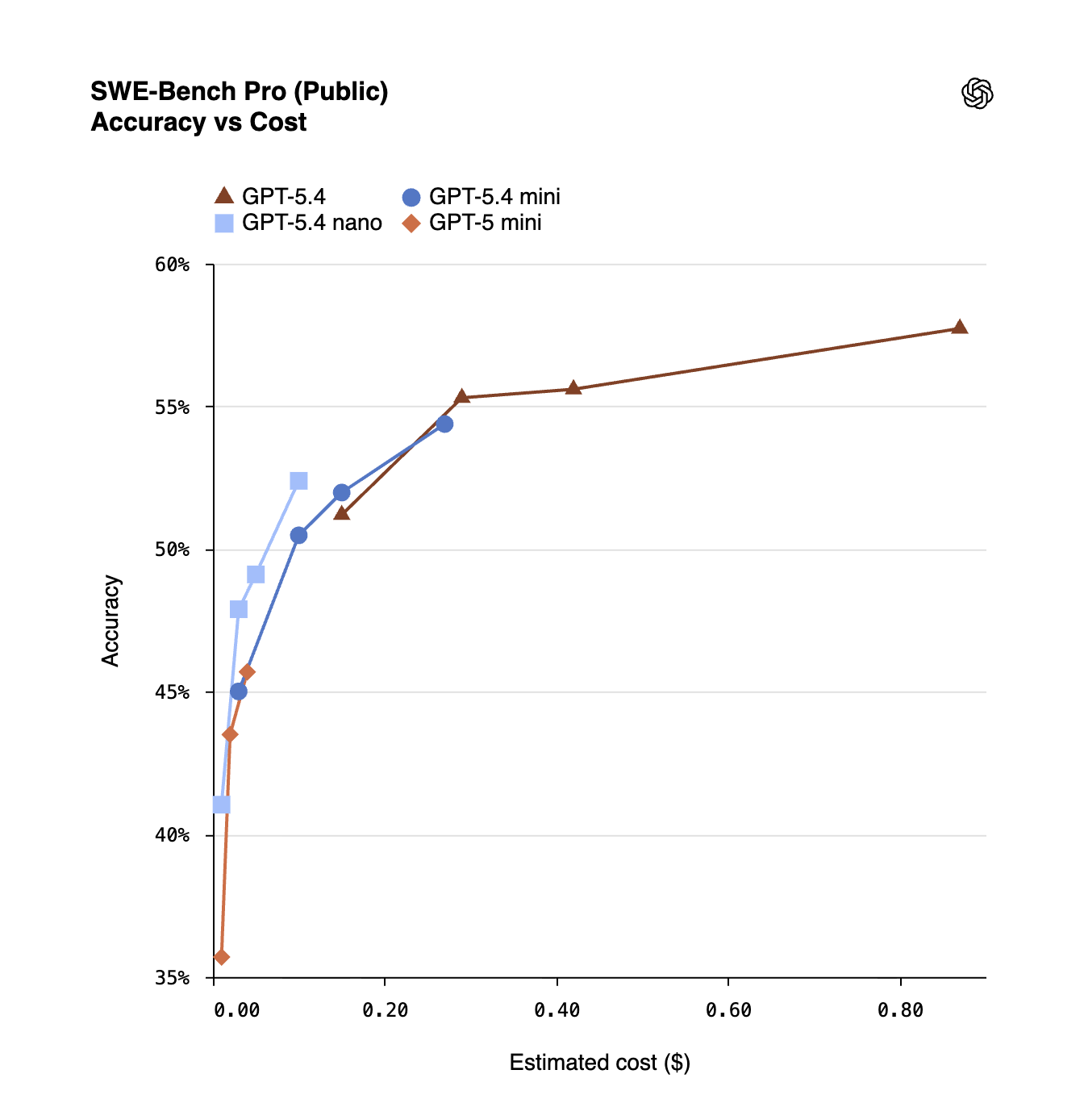

Бенчмарки: Mini подбирается к GPT-5.4

Вот главная таблица. Все модели тестировались на максимальном reasoning effort (xhigh для 5.4, high для GPT-5 Mini, потому что выше у неё нет).

| Бенчмарк | GPT-5.4 | GPT-5.4 Mini | GPT-5.4 Nano | GPT-5 Mini |

|---|---|---|---|---|

| SWE-Bench Pro | 57.7% | 54.4% | 52.4% | 45.7% |

| Terminal-Bench 2.0 | 75.1% | 60.0% | 46.3% | 38.2% |

| GPQA Diamond | 93.0% | 88.0% | 82.8% | 81.6% |

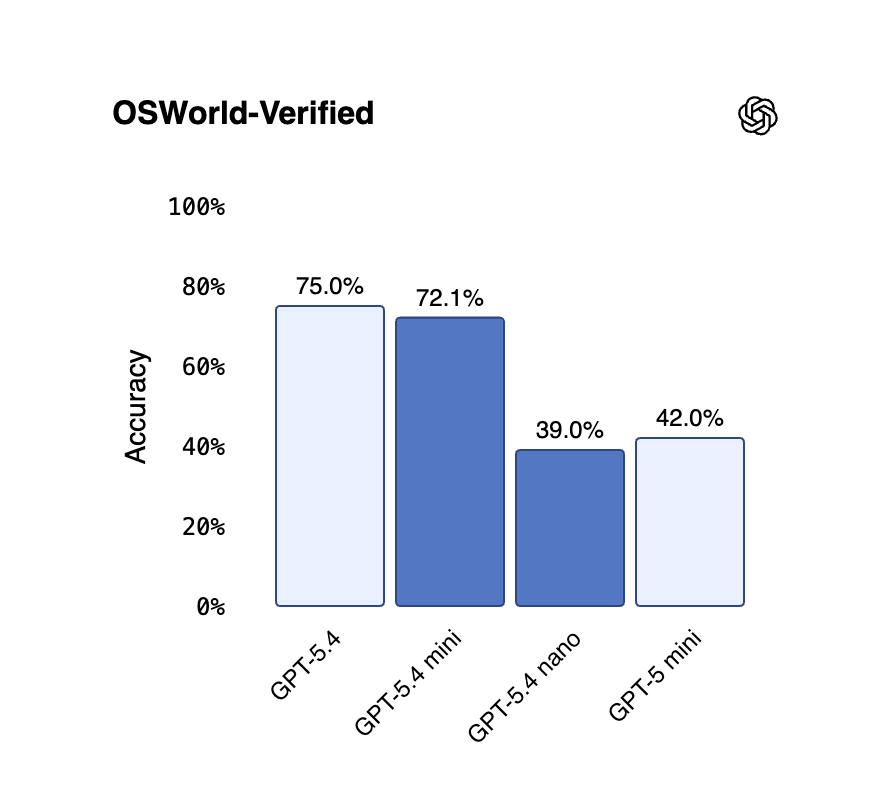

| OSWorld-Verified | 75.0% | 72.1% | 39.0% | 42.0% |

| Toolathlon | 54.6% | 42.9% | 35.5% | 26.9% |

SWE-Bench Pro показывает разницу между Mini (54.4%) и полноразмерной моделью (57.7%) всего в 3.3 процентных пункта. При этом Mini работает в 2 раза быстрее.

Кодинг: когда скорость важнее мощности

OpenAI позиционирует Mini и Nano как модели для coding workflows с быстрой итерацией. На практике это точечные правки, навигация по кодовой базе, генерация фронтенда и дебаг-циклы.

В Codex Mini использует только 30% квоты GPT-5.4. Это значит, что ты можешь переключаться между задачами: сложные вещи отдать полной модели, а рутину (поиск по коду, ревью файлов, обработку документов) скинуть на Mini и не думать о лимитах.

Nano в кодинге тоже полезна, хотя для других задач. SWE-Bench Pro на 52.4% говорит о том, что даже самая дешёвая модель в линейке решает больше половины реальных задач по коду. Для субагента, который обрабатывает простые подзадачи параллельно, этого достаточно.

Субагенты: главный сценарий для Mini

Думаю, самое важное в этом релизе не сами модели, а паттерн использования, который OpenAI продвигает. Большая модель (GPT-5.4) планирует и координирует. Маленькие модели (Mini, Nano) выполняют подзадачи параллельно.

В Codex это уже работает: GPT-5.4 решает, что делать, а Mini-субагенты ищут по кодовой базе, ревьюят файлы, обрабатывают документы. Документация по субагентам описывает этот подход подробнее.

Этот паттерн не уникален для OpenAI. Anthropic делает то же самое с Claude, где Opus координирует, а Haiku/Sonnet выполняют. Но OpenAI первыми встроили это прямо в продукт (Codex), а не оставили на уровне API.

Computer use: Mini видит интерфейсы

На мультимодальных задачах Mini показывает 72.1% на OSWorld-Verified, почти как полная GPT-5.4 (75%). Модель быстро разбирает скриншоты сложных интерфейсов и действует по ним.

Если ты строишь автоматизацию GUI (заполнение форм, навигация по приложениям, тестирование UI), Mini тут хороший выбор. Полная GPT-5.4 точнее на 3%, но медленнее и дороже втрое, и эти 3% редко оправдывают разницу.

Nano тут не подходит. 39% на OSWorld — ниже, чем у предыдущего поколения GPT-5 Mini. Для задач с визуальным пониманием ей пока не хватает.

Цены и доступность

| Модель | Input (за 1M токенов) | Output (за 1M токенов) | Контекст | Где доступна |

|---|---|---|---|---|

| GPT-5.4 Mini | $0.75 | $4.50 | 400K | API, Codex, ChatGPT |

| GPT-5.4 Nano | $0.20 | $1.25 | — | Только API |

Mini поддерживает текст и изображения, tool use, function calling, веб-поиск, file search, computer use и skills. Контекстное окно — 400K токенов.

В ChatGPT Mini доступна бесплатным пользователям и подписчикам Go через режим «Thinking». Для остальных тарифов Mini включается как фолбэк при достижении лимита GPT-5.4.

Nano — только через API. Для чат-ботов, классификаторов, пайплайнов извлечения данных и субагентов на простых задачах.

Вывод

Mini почти догоняет флагман на кодинге и computer use при вдвое большей скорости и втрое меньшей цене. Думаю, для большинства задач в Codex и API она станет дефолтом.

Nano, $0.20 за миллион входных токенов. На этом уровне можно гонять тысячи запросов без оглядки на бюджет. Для классификации и простых субагентов больше и не нужно.

Вообще, интересно тут не сами модели, а то, куда OpenAI ведёт. Они строят систему, где модели разных размеров работают вместе: большая думает, маленькие делают. Mini с Nano заточены именно под это.

Что ещё почитать

- GPT-5.4: computer use, tool search и 1M контекст — обзор основной модели GPT-5.4

- Мультиагенты в OpenAI Codex — как настроить субагентную архитектуру

- Топ-6 AI-агентов для кода в 2026 — подборка инструментов для кодинга с AI