GLM-5.1: китайская модель на 94.6% от Claude Opus в кодинге

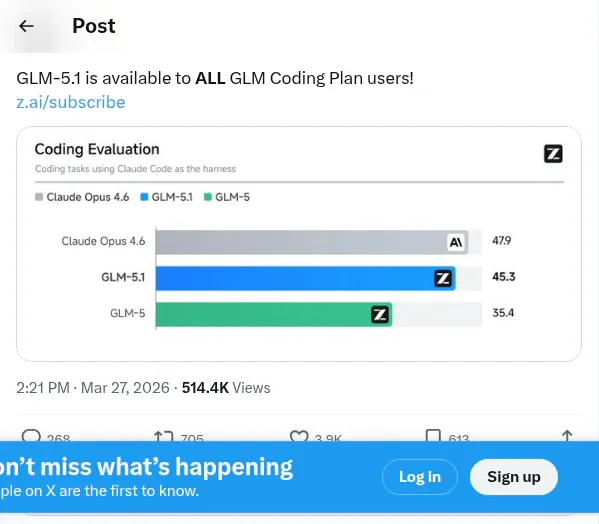

GLM-5.1 набрала 45.3 балла в кодинг-бенчмарке — всего 2.6 балла от Claude Opus 4.6. Обучена на чипах Huawei, скоро выйдет в open source под MIT.

TL;DR: GLM-5.1 от Z.ai набрала 45.3 балла в кодинг-бенчмарке — это 94.6% от Claude Opus 4.6. Модель обучена полностью на китайских чипах Huawei, скоро выйдет в open source под MIT, а подписка стоит от $10 в месяц. Рост на 28% по сравнению с предыдущей GLM-5.

GLM-5.1

Китайская компания Z.ai (раньше Zhipu AI) выкатила обновлённую версию своей флагманской модели. Пользователи Coding Plan начали получать письма о том, что GLM-5.1 доступна в рамках подписки.

Цифры такие: в тестировании через Claude Code модель набрала 45.3 балла против 47.9 у Claude Opus 4.6. Разрыв — всего 2.6 балла. Для сравнения, предыдущая GLM-5 набирала 35.4. То есть за полтора месяца прирост составил 28%.

Тестирование проводили через Claude Code — фреймворк от самой Anthropic. То есть модель играла на чужом поле. Набор задач, критерии оценки и методика подсчёта не раскрываются, поэтому цифры стоит воспринимать как относительное сравнение внутри одного теста, а не как абсолютный показатель.

Что внутри GLM-5.1

GLM-5.1 построена на фундаменте GLM-5, которая вышла в феврале 2026. Базовые параметры GLM-5:

- 744 млрд параметров (40 млрд активных при инференсе, архитектура Mixture of Experts)

- 28.5 трлн токенов данных для предобучения

- Контекстное окно 200K, до 128K токенов на выходе

- Интегрирован DeepSeek Sparse Attention для снижения стоимости деплоя

- Нативная поддержка MCP (Model Context Protocol)

Точные параметры самой GLM-5.1 пока не раскрыли, полный технический отчёт ещё не опубликован. Но компания подтвердила, что модель тоже будет open source. Глава Z.ai Ли Цзысюань написал 20 марта в X: «Don't panic. GLM-5.1 will be open source».

Ещё один момент: вся линейка GLM-5 обучена на чипах Huawei Ascend 910B. Ни одного GPU от NVIDIA. С учётом санкций на поставку чипов в Китай это скорее вынужденный ход, но результаты бенчмарков показывают, что ход удачный.

Бенчмарки: где GLM-5.1 сильна

Кроме кодинг-теста, базовая GLM-5 показала сильные результаты и в других бенчмарках:

| Бенчмарк | Результат | Контекст |

|---|---|---|

| Coding Evaluation | 45.3 | 94.6% от Claude Opus 4.6 |

| SWE-bench Verified | 77.8% | Лучший среди open-source моделей |

| Terminal Bench 2.0 | 56.2 | Тоже лучший среди открытых моделей |

SWE-bench — это реальные задачи из GitHub-репозиториев. 77.8% там для open-source модели — лучший результат на момент публикации.

Сколько стоит и где подключить

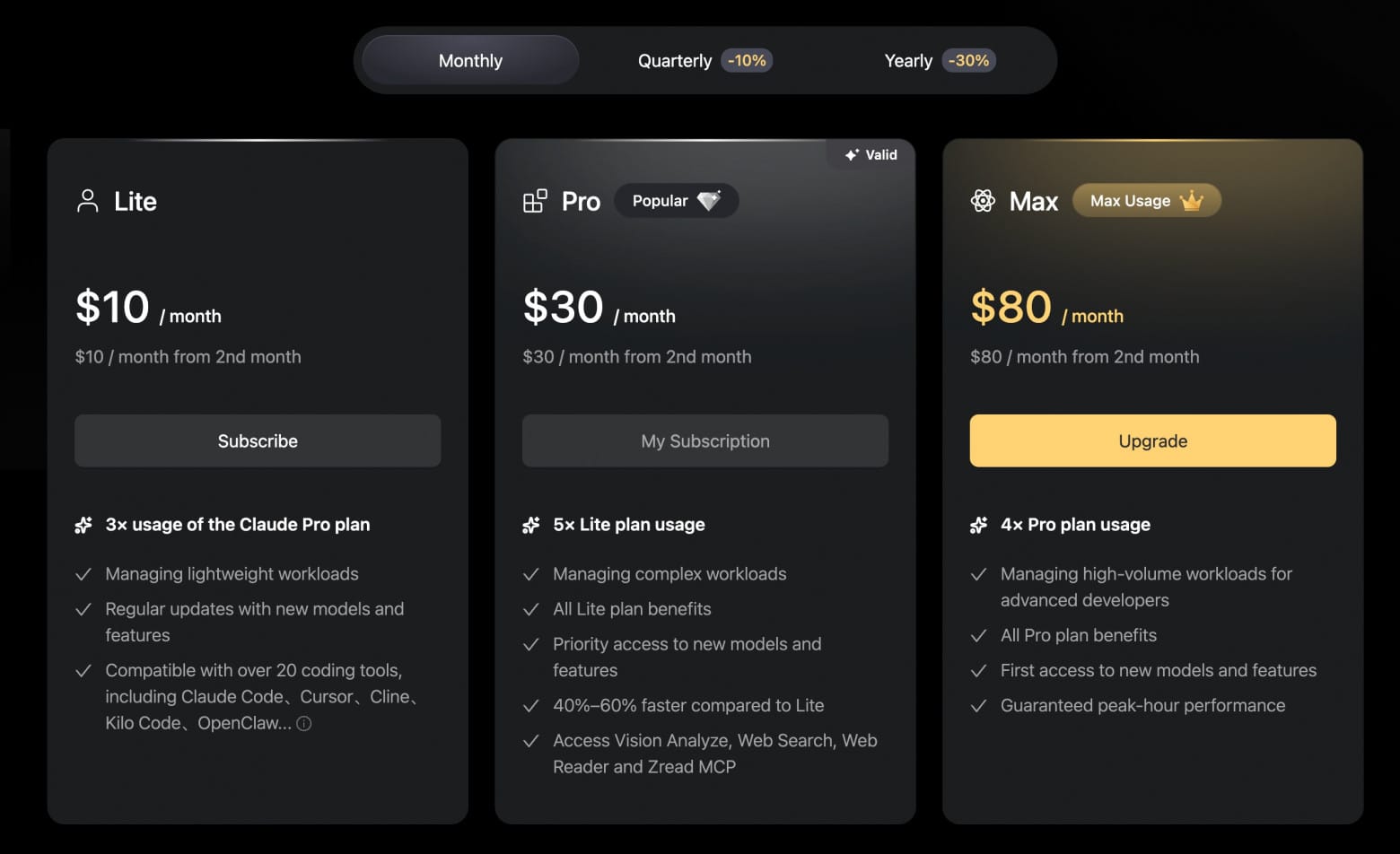

GLM-5.1 доступна через подписку GLM Coding Plan на платформе Z.ai. Три тарифа:

| Тариф | Цена | Лимиты |

|---|---|---|

| Lite | $10/мес ($3 промо) | 120 запросов за 5 часов |

| Pro | $30/мес ($15 промо) | 600 запросов за 5 часов |

| Max | расширенный | 4 000 поисковых запросов/мес |

Для контекста: Claude Max стоит $100–200 в месяц. При этом даже базовый Lite от Z.ai даёт тройной лимит использования по сравнению с подпиской Claude Code, а Pro — уже в 15 раз больше. Разница ощутимая.

Отдельный API для GLM-5.1 пока недоступен. API GLM-5 работает по цене $1 за миллион входных токенов и $3.20 за миллион выходных.

Как настроить GLM-5.1 в Claude Code

Модель совместима с Claude Code, OpenClaw и Cline. Настройка простая.

Для Claude Code: открой ~/.claude/settings.json и добавь:

{

"env": {

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-4.5-air",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-5.1",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5.1"

}

}

Перезапусти терминал и проверь через /status в Claude Code.

Для OpenClaw нужно добавить модель в ~/.openclaw/openclaw.json — в массив models.providers.zai.models и поменять primary на zai/glm-5.1. Подробная инструкция есть в документации Z.ai.

Для Cline и других инструментов с OpenAI-совместимым API: указываешь https://api.z.ai/api/coding/paas/v4 как Base URL, вводишь API-ключ Z.ai и пишешь glm-5.1 как название модели. Контекстное окно — 200 000 токенов.

Реальные впечатления от пользователей

На Хабре пользователь с подпиской на Z.ai, MiniMax, Codex и Gemini поделился наблюдениями. Говорит, что китайские модели не дотягивают до GPT-5.4, но по ощущениям находятся на уровне GPT-5.2 thinking. При этом лимиты намного щедрее.

Из минусов — был случай, когда агент на GLM-5 ушёл в бесконечный цикл размышлений и сожрал 7% недельной квоты. Возможно, это проблема opencode-агента, а не самой модели. С MiniMax M2.7 такого не было.

Сообщество LocalLLaMA на Reddit тоже обсуждает: связка GLM-5-Turbo для повседневных задач и GLM-5.1 для планирования даёт хорошие результаты при минимальных затратах.

Меня тут зацепили два момента.

Разрыв между open-source и закрытыми моделями сжимается прямо на глазах. Менее 3 баллов до Claude Opus в кодинг-бенчмарке — ещё год назад такое казалось нереальным.

Ну и доступность. Китайские API работают без VPN из многих корпоративных сетей, где западные сервисы заблокированы. Для части разработчиков это вообще единственный способ использовать LLM в работе.

Qwen 3.6-Plus от Alibaba, MiniMax M2.7, теперь GLM-5.1. Китайские модели уже не «дешёвая альтернатива», а полноценные конкуренты.

Что ещё почитать

- GLM-5-Turbo: цены, сравнение с GLM-5 и настройка OpenClaw — предыдущий обзор линейки GLM-5

- Qwen 3.6-Plus: Alibaba бросает вызов Claude в агентном кодинге — ещё одна китайская модель, конкурирующая с Claude

- MiniMax M2.7: модель, которая сама себя обучала — альтернативная китайская модель для кодинга

- Топ-6 AI-агентов для кода в 2026 — подборка инструментов, с которыми можно использовать GLM-5.1